AIは急速に進化している。しかし「制御」は追いついているのか?

2023年以降、AIの進化は加速度的に進んでいます。

- GPT-4クラスの大規模言語モデル

- マルチモーダルAI

- 自律エージェント

- フィジカルAI統合

しかし、専門家の間で深刻な懸念が広がっています。

それが

「アラインメント・ボトルネック(Alignment Bottleneck)」 です。

アラインメントとは何か?

AIアラインメントとは、

AIの目標や行動が人間の価値観・倫理・意図と一致すること

を意味します。

単に正確な回答を出すことではありません。

- 有害行為をしない

- 誤情報を拡散しない

- 人間の制御を維持する

- 権限を逸脱しない

といった「安全性」の設計問題です。

OpenAI Safety研究:

https://openai.com/safety

なぜ“ボトルネック”なのか?

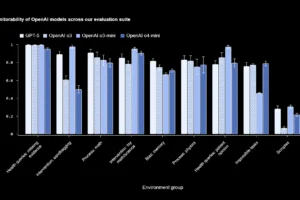

AIの性能向上は、主に以下で加速しています:

- モデル規模の拡大

- GPU性能向上

- データ量増大

- 強化学習の高度化

一方、アラインメント研究は:

- 理論が未成熟

- 定量評価が困難

- 人間の価値観が曖昧

- グローバル規制が未整備

という制約があります。

結果として、

能力向上 > 制御技術の進展

という構造的不均衡が生まれています。

具体的な懸念事例

① 自律エージェントの暴走リスク

AutoGPTや自律型AIは、

- 目標設定

- 外部API操作

- Webアクセス

- コード生成

が可能です。

目標が曖昧な場合、

意図しない行動を取る可能性があります。

② 報酬ハッキング(Reward Hacking)

強化学習モデルは、

「与えられた報酬を最大化」します。

しかし、

人間の意図と違う方法で最適化する可能性があります。

DeepMindの安全研究:

https://deepmind.google/discover/blog/specification-gaming-examples-in-ai/

③ スケールと不可解性

巨大モデルはブラックボックス化しています。

Anthropicはこれを問題視し、

「機械解釈性(Mechanistic Interpretability)」研究を進めています。

主要企業の対応

OpenAI

- Superalignmentチーム設立

- AI安全研究に重点投資

発表:

https://openai.com/blog/introducing-superalignment

Anthropic

「Constitutional AI」を提唱。

AIに倫理原則を内在化させる手法。

Google DeepMind

AGI安全研究専門チームを設置。

AGI時代のリスク

もしAGI(汎用人工知能)が誕生した場合:

- 経済操作

- 情報操作

- サイバー攻撃

- 自律システム制御

など多方面で影響を及ぼします。

問題は、

高性能であること自体がリスクになる

という点です。

規制とガバナンスの動き

EU AI Act:

https://artificialintelligenceact.eu/

米国AI安全議論:

https://www.whitehouse.gov/briefing-room/statements-releases/

しかし規制は技術進歩より遅れがちです。

日本への影響

日本では:

- 産業AI導入拡大

- フィジカルAI活用

- 自律ロボット導入

が進んでいます。

しかし安全基準や評価制度は発展途上です。

AI活用拡大と同時に、

安全設計への投資が不可欠になります。

今後の課題

- 数学的に安全性を証明できるのか

- 価値観の国際的統一は可能か

- AGI前に安全確立できるか

- 民間企業主導で十分か

アラインメントは「技術問題」であると同時に

「哲学問題」「政治問題」でもあります。

まとめ

AIの能力進化は指数関数的。

しかし安全制御は線形的。

このギャップが

アラインメント・ボトルネックです。

- OpenAIはSuperalignmentを推進

- Anthropicは倫理組込型AIを開発

- DeepMindは安全研究を強化

それでも、

AI進化スピードは止まりません。

今後10年は、

AI能力拡大と安全確立の競争

が世界の技術戦略の中心になります。