AIインフラと聞いて、何を思い浮かべるでしょうか?

これまでは答えは単純でした。

高性能GPU。

しかし2026年現在、その認識は急速に変わっています。

AIインフラはもはや「チップ競争」だけではありません。

本当の競争は、

- 電力供給

- 冷却技術

- モジュール型ポッド設計

へと移行しています。

■ GPUは出発点にすぎない

NVIDIAのデータセンター戦略(https://www.nvidia.com/en-us/data-center/)では、単体GPUではなく**AI SuperPOD**と呼ばれる大規模クラスター設計が強調されています。

SuperPODは、

- 数千基のGPU

- 高速インターコネクト

- 電力最適化設計

- 冷却システム統合

を前提としたパッケージ設計です。

つまり、GPU単体の性能よりも「システム全体設計」が重要になっています。

■ 電力が最大の制約に

国際エネルギー機関(IEA)の報告によれば、データセンターの電力消費は急増しており、AIワークロードがその増加を牽引しています。

https://www.iea.org/

大規模AIモデルの学習には、数百メガワット規模の電力が必要になるケースもあります。

もはや問題は:

「どのGPUを買うか」ではなく

「どこで電力を確保できるか」

です。

再生可能エネルギーとの統合や、電力需給のリアルタイム最適化も重要なテーマになっています。

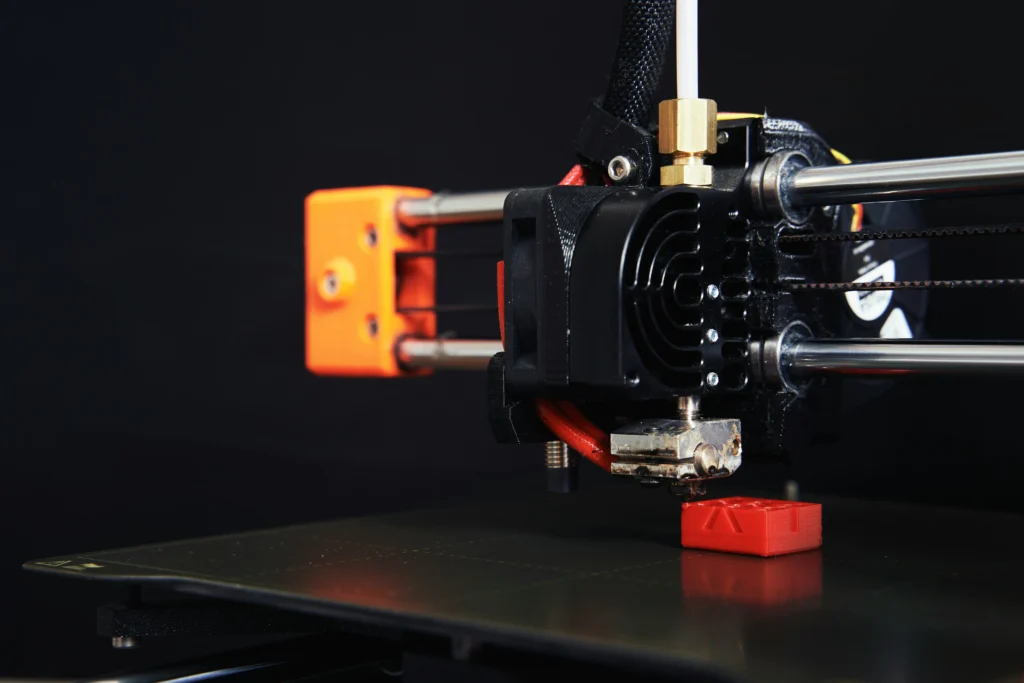

■ 冷却:空冷の限界と液冷革命

AIサーバーは従来型空冷では限界に達しつつあります。

そのため、

- 直接液冷(Direct-to-Chip)

- 液浸冷却(Immersion Cooling)

が急速に採用されています。

Googleもデータセンター冷却技術の最適化を継続的に発表しています。

https://cloud.google.com/blog/

液冷は:

✔ エネルギー効率向上

✔ 高密度ラック実現

✔ 安定稼働

を可能にします。

冷却は、もはや補助設備ではなく「コア技術」です。

■ ポッド設計という新たな単位

AIデータセンターは「建物単位」から「ポッド単位」へ。

ポッドとは:

- モジュール型設計

- 自律電源管理

- 専用冷却

- ネットワーク統合

を備えたユニットです。

NVIDIA SuperPODはその代表例です。

これにより、迅速な展開と拡張が可能になります。

■ なぜ今変わっているのか?

理由は3つあります。

- モデル規模の爆発的拡大

- 推論需要の常時化

- AIを前提としたクラウド設計

AIはピーク時だけではなく、常時稼働しています。

そのため、安定した電力と冷却が不可欠です。

■ チップ競争から“物理インフラ競争”へ

半導体は依然重要です。

しかし勝敗を分けるのは:

✔ 電力調達能力

✔ 冷却技術効率

✔ 展開速度

✔ インフラ統合設計

になりつつあります。

これはクラウド企業、エネルギー企業、不動産企業まで巻き込む競争です。

■ まとめ

AIインフラは、もはやチップだけの話ではありません。

それは:

電力 × 冷却 × ポッド設計

の総合戦です。

GPUは心臓部ですが、

電力と冷却がなければ動きません。

2026年のAI競争は、物理インフラの戦いでもあります。