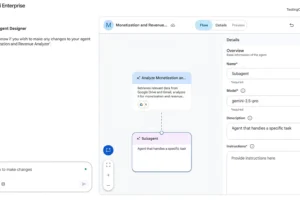

Google、AI駆動の音声・視覚クエリで検索エンジンを強化

Googleは、検索エンジンに人工知能(AI)をさらに強化し、ユーザーが画像について音声で質問できる機能を導入するほか、特定のトピックに関するAI生成の結果を提供する新しいアップデートを発表しました。この発表は、5月に導入された「AIオーバービュー」から始まったGoogleの検索サービスのAI主導の変革における次のステップです。AIオーバービューは、検索結果ページのトップにAIによって作成された要約を表示するもので、発表当初から注目を集めていました。

AIオーバービューとその影響

AIオーバービューは、従来の検索リンクをクリックするユーザーが減少するのではないかと懸念する出版社からの懸念を引き起こしました。これに対して、GoogleはAI生成の要約にさらに多くの外部リンクを追加する対応を行っています。BrightEdgeの最新の調査によると、AIオーバービューは一部のニュースサイトのトラフィックを減少させる一方で、Bloombergや国立衛生研究所(NIH)のような専門サイトへのトラフィックを増加させています。

GoogleのAI主導の検索への取り組み

Googleが検索エンジンにAIをさらに深く統合する決定は、技術の未来をAIに託す姿勢を鮮明にしています。この検索エンジンはGoogleの2兆ドル規模のビジネスの要であり、Googleは新たなAIベースの競争相手であるChatGPTやPerplexityに対抗する形でこの技術の導入を進めています。

新機能:音声クエリと物体認識

今回のアップデートは、Googleが7年前に導入したLens機能を基盤としています。Lensは写真からの視覚的クエリを処理し、月間200億件以上のクエリに対応しています。この機能は特に18歳から24歳のユーザーに人気があります。新しいフェーズでは、ユーザーがカメラレンズを通して見ている物体について英語で会話風の質問をし、その結果を得ることができるようになります。また、Google Labsの実験プログラムに参加しているユーザーは、動いている物体、たとえば水槽の中を泳ぐ魚の動画を撮影し、それに関する音声質問をし、AIオーバービューを通じて回答を得ることができます。

「我々の目標は、検索をより簡単に、より手軽に利用できるようにし、ユーザーがどこにいても、どんな方法でも検索できるようにすることです」と、Googleの検索エンジニアリング担当副社長であり、Lens機能の共同創設者でもあるRajan Patel氏は述べています。

リスクとAIの過去の誤りへの対応

GoogleのAIの進歩は検索の利便性を向上させる可能性がある一方で、技術にはリスクも伴います。AIシステムは時折不正確な情報を生成し、Googleの検索エンジンの信頼性を損なう恐れがあります。これまでに、AIオーバービューが「ピザに接着剤を塗る」や「岩を食べる」といった誤ったアドバイスをするなど、いくつかの顕著なミスがありました。Googleはこれらのエラーを、データの欠如や、AI技術を故意に誤った方向に誘導するオンラインの悪意あるユーザーによるものだと説明しています。

こうした課題にもかかわらず、Googleは多くの問題を解決したと自信を示しており、AIが特定の検索結果を整理する役割を担うように進化させています。最初に試行されるのは、モバイル端末で入力されたレシピや食事のアイデアに関するクエリに対するAI主導の結果です。これらの結果は、写真、動画、記事といった異なるカテゴリに分けられ、ユーザーが情報を簡単にナビゲートできるようにする予定です。

Googleが検索エンジンにAIをさらに深く統合することで、オンラインでの情報との対話方法に新しい時代が到来します。しかし、Googleはユーザーの信頼を維持するため、AIツールに関連するリスクを慎重に管理する必要があります。