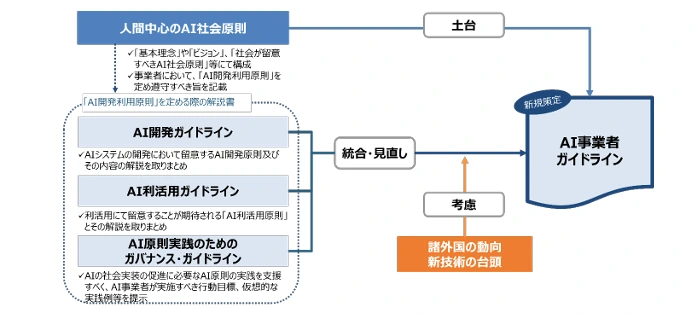

日本のAIガバナンスは、理念や原則論から、企業が運用に落とし込める“実務モード”へ移っています。経産省・総務省が公表した**「AI事業者ガイドライン(AI Guidelines for Business)」**は、AIのリスクを認識し、ライフサイクル全体で対策を講じることを中心に据えた点が特徴です。

ライフサイクル全体を貫く「リスク認識→対策」の考え方が重要

重要性:AIは導入時点だけでなく、学習データの更新・モデル変更・運用環境の変化でリスクが変動します。ガイドラインは、企業が国際動向や関係者の懸念を踏まえてリスクを十分に認識し、全ライフサイクルで必要な対策を自主的に講じることを狙いとして明記しています(AI Guidelines for Business Ver1(PDF))。

企業が「今すぐ実装」しやすいチェックリスト(実務向け)

ここからは、ガイドラインの“企業フレンドリー”な読み方として、現場に落とし込みやすい項目をチェックリスト化します(参照:経産省のガイドライン一覧ページ)。

人の関与(Human Review / Human-in-the-loop)

重要性:重要判断をAIに委ねるほど、誤りや偏りがそのまま業務影響になります。

実装チェック:

- 「どの判断を人が最終承認するか」をAI利用シーンごとに定義(例:与信・採用・価格・安全制御)。

- 高リスク用途は“自動実行”を避け、承認フロー(担当→責任者)を設計。

- 判断根拠(入力・出力・参照情報)をレビューできるUI/手順を用意。

(ガイドラインの背景と狙い:METI/MICの取りまとめ発表(英語))

ロギングと監査(Logging / Auditability)

重要性:問題発生時に「何が起きたか」を再現できないと、是正も説明責任も果たせません。

実装チェック:

- 入力(プロンプト/パラメータ/参照データ)、出力、実行時刻、モデル/バージョン、権限・操作者を記録。

- ログの保管期間・改ざん防止(WORM等)・アクセス制御を定義。

- 監査・第三者確認に耐える形で、変更履歴(モデル更新・設定変更)を残す。

(ライフサイクル全体での対策方針:AI Guidelines for Business Ver1(PDF))

データ取り扱い(Data Handling:個人情報・機密・学習データ)

重要性:AIの品質とリスクはデータで決まります。個人情報・機密・著作物などは法務/セキュリティの論点に直結します。

実装チェック:

- 入力データの区分(公開/社外秘/個人情報/特定機微)と送信可否をルール化。

- 学習・再学習に使うデータの出所、権利、同意、保存期間を管理。

- 生成AIに機密を入れないためのDLP、マスキング、プロンプトガードを実装。

(ガイドラインを統合・更新して策定した趣旨:METI/MICの取りまとめ発表(英語))

リスク評価(Use-caseごとのリスク分類と対策の深さ)

重要性:「全社で一律」ではコスト過多か、逆に抜け漏れになります。

実装チェック:

- ユースケースごとに影響度(安全・人権・財務・信用・法令)を評価し、対策レベルを変える。

- 高リスク用途は、検証項目(精度・偏り・堅牢性・安全)を増やし、リリースゲートを厳格化。

- ベンダー/外部モデル利用時は、責任分界(SLA、データ利用、再学習可否)を契約で明確化。

(ガイドラインの位置づけ:経産省ページ)

インシデント対応(Incident Response:検知・停止・連絡・再発防止)

重要性:AIは不具合が“静かに拡散”しやすく、誤出力が顧客接点に出ると信用毀損が大きい。

実装チェック:

- 重大インシデントの定義(個人情報漏えい、誤案内、差別的出力、安全侵害など)を策定。

- “止め方”を事前に決める(機能停止、モデル切替、ルールベースへフェイルバック)。

- 連絡フロー(CS/法務/広報/セキュリティ/経営)と証跡確保(ログ保全)を手順化。

- 再発防止:原因分析→データ/プロンプト/モデル/運用のどこを直すかを明確化。

(実務的な全体方針:AI Guidelines for Business Ver1(PDF))

変更管理(Model/Prompt/Policy Change Management)

重要性:運用での小さな変更(プロンプトや設定)が、結果を大きく変えることがあります。

実装チェック:

- モデル更新・プロンプト変更・RAGデータ更新を「変更」として扱い、レビュー/承認/ロールバックを用意。

- 主要KPI(正確性、幻覚率、逸脱、苦情件数)をモニタリングし、閾値で自動アラート。

- バージョン固定(pinning)と段階リリース(カナリア/AB)を設計。

(ライフサイクル全体での対策という柱:ガイドライン(METI))

Conclusion(全体傾向の要約)

日本のAIガバナンスは、原則の提示に加えて、企業が導入・運用で実装できるライフサイクル型のリスク管理へと実務化が進んでいます。ポイントは、AIの性能評価だけでなく、人の関与、監査ログ、データ統制、インシデント対応、変更管理を“仕組み”として整えることです。まずは上記チェックリストを、社内のAI利用ケースに当てはめてギャップを可視化するところから始めると、**「AI事業者ガイドライン」**の意図する「リスクを認識し、必要な対策をライフサイクル全体で講じる」運用に近づきます。