日本のAI法(通称「AI推進法」)は、AIの研究開発・活用を国家として後押ししつつ、リスクにも対応する“促進+実務対応”の枠組みとして設計されています。内閣府によれば同法は2025年6月4日に公布・一部施行され、2025年9月1日に全面施行されています(内閣府のAI法ページ/AI法概要PDF)。本稿では、EU/米国との比較視点も交えつつ、企業が「今すぐ整備」できる備えをチェックリスト化します。

日本のAI法は「推進」を前面に出しつつ、リスク対応を制度化する

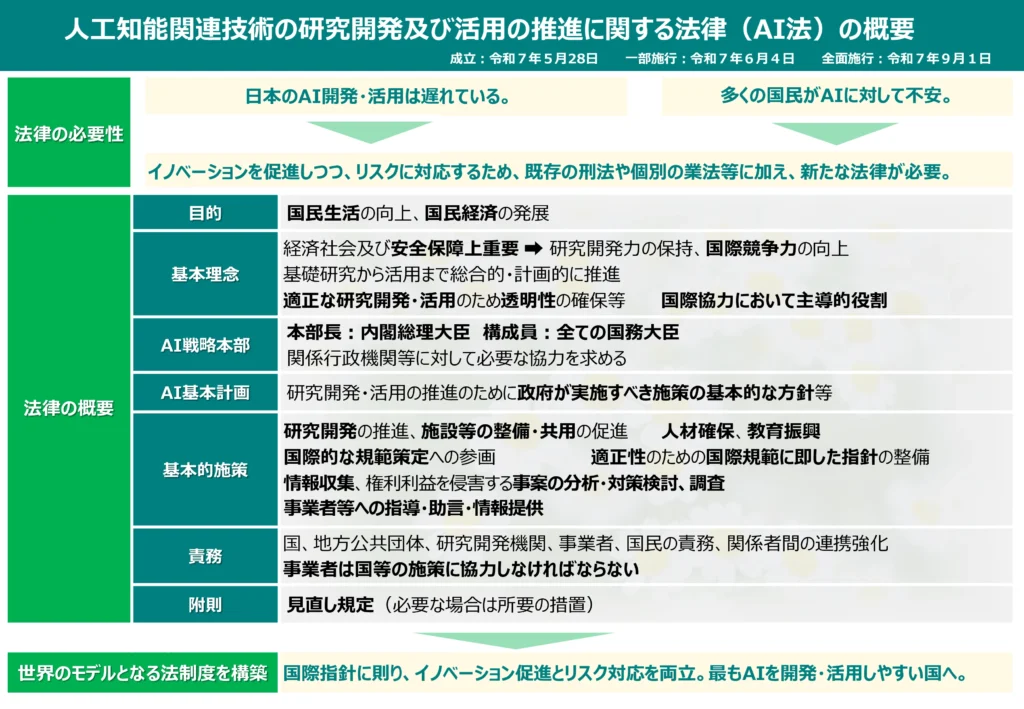

重要なのは、AI法が“開発と活用を総合的・計画的に推進する”ことを基本理念に置きながら、透明性確保や指針整備、リスク事案の分析・対策検討などを政策手段として位置づけている点です(AI法概要PDF)。

同資料では、AIの発展が生活・経済に寄与する一方、国内のAI開発・活用の遅れと国民の不安があることを踏まえ、「イノベーションを促進しつつ、リスクに対応」する必要性が明記されています(AI法概要PDF)。

企業視点で効いてくるのは「AI戦略本部」「AI基本計画」「指針(ガイドライン)」

AI法は、内閣総理大臣を本部長とし全閣僚で構成するAI戦略本部の設置、政府が実施すべき施策の方針を定めるAI基本計画、そして国際規範に即した指針整備などを柱に据えています(AI法概要PDF)。

企業にとって重要なのは、これらが「一度作って終わり」ではなく、運用現場で使える形へアップデートされる“政策実装ループ”になり得る点です。実際、内閣府は全面施行後の動きとしてAI戦略本部の開催や基本計画策定の議論に触れています(内閣府:AI法 全面施行(New Wave))。

海外比較で見える、日本の立ち位置(EU/米国)

国際比較の記事に向くポイントは、「義務・適合の設計思想が異なる」点です。

- EU:法規制としてのAI Act(リスクベースで義務を課す設計)

EU AI Actは2024年に発効し、全体適用は2026年8月を基本線としつつ条項ごとに適用時期が分かれる整理が示されています(欧州議会の解説資料(EPRS))。 - 米国:包括法よりも、枠組み・ガイダンス・部門規制の組み合わせ(当面は“分散型”)

代表例として、NISTのAI Risk Management Framework(AI RMF 1.0)は、組織がAIリスクを管理するための任意のフレームワークとして提供されています(NIST AI RMF(公式)/AI RMF 1.0 PDF)。 - 日本:推進(競争力・研究開発・活用)を前面に、指針整備・情報収集・事案分析・助言でリスク対応を組み込む

AI法概要では、基本的施策として「指針整備」「情報収集」「権利利益を侵害する事案の分析・対策検討」「事業者等への指導・助言・情報提供」などが整理されています(AI法概要PDF)。

企業が「今すぐ実装」できる備え(実務チェックリスト)

ここからは、AI法が示す方向性(推進+リスク対応)を、企業の実装タスクに落とし込みます。特に、監査・説明責任・事故対応に直結する項目は“先に作っておくほど”運用負荷が下がります。

ガバナンス(責任者と適用範囲の明確化)

- AI利用の責任体制(オーナー部署、承認者、監督責任)を定義

- どの業務がAI対象か(高リスク用途/一般用途)を棚卸し

- 外部モデル利用時の責任分界(SLA、再学習、データ保持)を契約で確認

→ AI法が掲げる「適正な研究開発・活用のための透明性確保」や「指針整備」の流れに合わせ、社内統制を整えることが後追いコストを減らします(AI法概要PDF)。

人の関与(Human review)

- 高影響の判断(採用、与信、医療、重要インフラ)は人が最終判断

- 自動実行は段階的に(まずは提案→承認→実行)

→ “推進”路線でも、事故時に説明できる運用設計が必要です(内閣府:AI法ページ)。

ログ・監査(再現性の確保)

- 入力、出力、モデル/バージョン、参照データ、操作者、実行時刻をログ化

- 変更管理(モデル更新、プロンプト変更、RAGデータ更新)を「変更」として記録

→ AI法は情報収集や事案分析・対策検討を施策として挙げており、企業側も「後から追える」状態を作ると整合します(AI法概要PDF)。

データ取り扱い(機密・個人情報・学習データ)

- 機密/個人情報の投入可否、マスキング、DLP(Data Loss Prevention)を整備

- 学習データの出所、権利、同意、保存期間、再利用条件を管理

→ “活用推進”の中でトラブルが起きやすいのはデータ境界です。先にルール化すると運用が安定します(内閣府:AI法ページ)。

インシデント対応(止め方・連絡・再発防止)

- 重大インシデント定義(漏えい、誤案内、差別的出力等)

- 緊急停止(kill switch)、フェイルバック(ルールベース切替)

- ログ保全→原因分析→再発防止(データ/モデル/運用のどこを直すか)

→ AI法概要は、権利利益侵害の事案分析や対策検討、調査を政策として挙げており、企業にも“事故対応の型”が求められます(AI法概要PDF)。

結論

日本のAI法は、EUのように義務適合を中心に据える設計とは異なり、研究開発・活用の推進を前面に置きながら、指針整備や事案分析、助言といった仕組みでリスク対応を組み込む枠組みとして整理されています(AI法概要PDF)。企業は「規制が厳しいかどうか」ではなく、推進政策の下でAI利用が広がることを前提に、ガバナンス・ログ・データ管理・インシデント対応を先に実装しておくことが、国内外の比較記事でも説得力のある“備え”になります。